[con]Neurona Episodio 25

La Ley de IA de la Unión Europea, Gemini, Grok, Mistral ... una semana cargada de novedades.

Esta edición aborda temas candentes, desde la recién aprobada Ley de Inteligencia Artificial en la UE hasta los modelos de vanguardia como Mistral y Gemini. Además, nos sumergiremos en el intrigante mundo de las arquitecturas de red neuronal, destacando el revolucionario diseño MoE y las potentes capacidades de AlphaCode 2.

También desglosamos las últimas investigaciones, discutimos novedades en código abierto, exploramos lanzamientos destacados y analizamos papers que están dando forma al futuro de la inteligencia artificial.

Ley de IA de la Unión Europea

El acuerdo debe ser adoptado formalmente por el Parlamento y el Consejo para convertirse en ley de la UE.

1 → Lo que tenemos

Se establecen medidas para proteger contra la IA de alto riesgo que pueda afectar a la salud, seguridad, derechos fundamentales, medio ambiente, democracia y Estado de derecho.

Se prohíbe el uso de sistemas de categorización biométrica con características sensibles, la extracción no dirigida de imágenes faciales, el reconocimiento de emociones en entornos laborales y educativos, puntuaciones sociales basadas en comportamientos, y la manipulación de comportamientos humanos.

Se acuerdan excepciones limitadas para el uso de sistemas de identificación biométrica en espacios públicos con fines policiales, sujeto a autorización judicial previa y para delitos estrictamente definidos.

Los sistemas de IA clasificados como de alto riesgo deben cumplir con evaluaciones obligatorias del impacto en los derechos fundamentales, entre otros requisitos, incluyendo el sector bancario y de seguros.

Los sistemas de IA de propósito general deben cumplir con requisitos de transparencia, documentación técnica, cumplimiento de la ley de derechos de autor de la UE y difusión de resúmenes detallados sobre el contenido utilizado para la capacitación.

Se promueven entornos de pruebas regulatorios y pruebas en el mundo real para permitir el desarrollo de soluciones de IA innovadoras, especialmente para las pymes.

Las multas por incumplimiento de las normas van desde 35 millones de euros o el 7% del volumen de negocios global hasta 7,5 millones o el 1,5% del volumen de negocios, dependiendo de la infracción y el tamaño de la empresa.

2 → Lo que pienso

La Unión Europea busca ejercer influencia política en cuestiones relacionadas con la inteligencia artificial. Dado que no la tiene en el ámbito económico de la IA , busca alcanzarla a través de la regulación.

La definición de Modelos del Alto Riesgo se queda corta … el futuro no está en un único modelo, aunque sí quizás en que varios más pequeños trabajen juntos.

Se prohíben algunos sistemas sensibles como categorización biométrica … con excepciones … ¿y quien es el beneficiario de estas excepciones ? … si, lo has adivinado el Estado … mmm !!! no se, no se…

Y, por último, ¿posee la Unión Europea los recursos necesarios para supervisar todos los modelos y sus variantes que llegarán al mercado? ¿Cuáles son los medios disponibles para llevar a cabo esta tarea?

… “parece que hemos evitado cualquier necesidad de licencias o similares para los modelos básicos, y la distribución de código abierto está permitida e incluso aparentemente fomentada.” [Julian Togelius en X/Twitter]

Novedades en Open Source

Zephyr

Zephyr, una versión perfeccionada de Mistral, aplicó algunas técnicas de afine que lo llevaron a superar en rendimiento al LLaMA 70B y otros modelos mucho más grandes. Funciona mejor en Inglés → [Demo][GitHub]. Lo curioso es que inicialmente el modelo se ajustó en una variante de UltraChat conjunto de datos, que contiene una amplia gama de diálogos sintéticos generados por ChatGPT

Hábitat 3.0

Meta AI presenta Hábitat 3.0 de código abierto , la versión más reciente de su marco para crear agentes de IA incorporados que pueden percibir e interactuar con su entorno, compartir ese entorno de forma segura con socios humanos, comunicarse y ayudar a esos socios humanos tanto en el mundo digital como en el físico. Osea … Robots Socialmente Inteligentes.

Mistral

El modelo MoE de Mistral, que se lanzó de manera como un torrent de 87 GB, ha despertado la atención por su aparente relación con una versión reducida de GPT-4. Este lanzamiento sorprendentemente se llevó a cabo sin un comunicado de prensa formal, y Mistral AI ha optado por no revelar más detalles.

Justo lo contrario que el modelo Gemini de Google, por otro lado, ha causado revuelo en la comunidad de IA con un video de demostración que, aunque cuidadosamente ensayado, ha sido objeto de críticas intensas.

Estás son sus características:

Modelos Expertos: Redes neuronales más pequeñas altamente entrenadas en áreas específicas, cada una procesando la misma información de manera única según su especialización.

Gating Network: Toma decisiones cruciales evaluando qué experto es más adecuado para un dato de entrada dado. Calcula puntuaciones de compatibilidad y determina la participación de cada experto en la tarea.

Mistral 8x7B presenta una arquitectura sorprendentemente similar a GPT-4, pero con notables reducciones:

8 expertos en lugar de 16 (reducción de 2x)

7 mil millones de parámetros por experto en lugar de 166 mil millones (reducción de 24 veces)

42 mil millones de parámetros totales estimados en lugar de 1,8 T (reducción de 42 veces)

Mantiene el mismo contexto de 32K que el GPT-4 original.

[Torrent 87GB] o esta primera prueba [Replicate API]

Conceptos

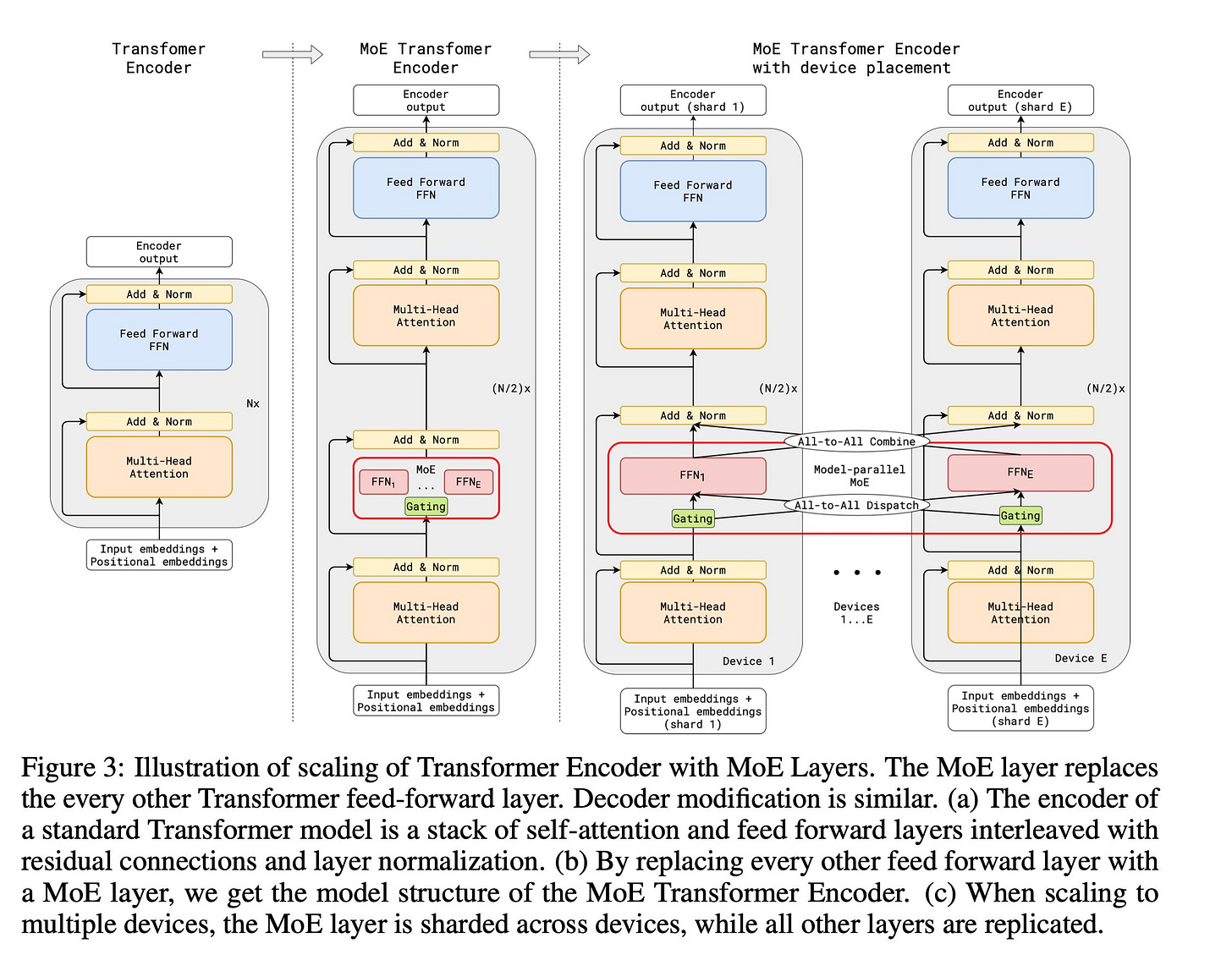

Aprovechando el lanzamiento de MoE Mistral, te puede interesar conocer a grandes rasgos qué es MoE:

¿Que es MoE?

MoE es un diseño de arquitectura de red neuronal que integra varios modelos. A medida que los datos fluyen a través de las capas del MoE, cada token de entrada se enruta dinámicamente a un subconjunto de expertos para su cálculo. Este enfoque permite una computación más eficiente con mejores resultados a medida que cada experto se especializa en tareas particulares. [Sophia Yang]

Cada experto puede especializarse para manejar diferentes tareas o diferentes partes de los datos y además trae consigo una serie de beneficios

-Agrega parámetros a los LLM sin aumentar el costo de inferencia

- Puede utilizar cálculos eficientes en matrices dispersas

- Calcula todas las capas expertas en paralelo para utilizar eficazmente las capacidades paralelas de las GPU.

- Ayuda a escalar el modelo de manera eficiente con un tiempo de entrenamiento reducido.

Lanzamientos de la semana

Google Gemini

Google presenta su modelo Gemini, en tres versiones: Gemini Pro, Gemini Ultra y Gemini Nano. Son modelos multimodales lanzados con mucho “bombo” pero que todavía no podemos analizar. Para explicarlo claro Gemini Pro sería el equivalente en capacidad y rendimiento a GPT 3.5, Gemini Ultra cercano a GPT 4 y Gemini Nano de menor tamaño para poder integrarlo en dispositivos móviles y periféricos.

Nada nuevo dadas las expectativas generadas por Google, aun así la gente se volvió loca promocionando un video publicitario del asunto. Con esto no quiero decir que sea un modelo “malo”, al contrario probablemente sea el primero que se acerca a GPT 4 y sin lugar a dudas Google tendrá mucho que decir en esta carrera.

Grok

Por fín se lanza Grok, el Chat de IA de Elon Musk, y está disponible solo para estados unidos aunque como bien dice David Garrido en Twitter/X, es fácil saltarse la restricción utilizando la VPN del navegador Opera o alguna extensión de Navegador para VPNs.

Mi opinión, una imitación bastante pobre (de momento), de la idea explotada por perplexity o algo asi.

AlphaCode 2

Programación Nivel dios, con este modelos de Google DeepMind.

AlphaCode 2 resuelve el 43% de los problemas de la competición en Codeforces, una mejora de 2× respecto al AlphaCode anterior. Se estima que se encuentra en el percentil 85 en promedio, superando al 99,5% de los participantes en los concursos de mejor rendimiento.

El rendimiento aumenta aproximadamente de manera logarítmica con más muestras, haciendo que AlphaCode 2 sea más de 10,000 veces más eficiente en muestras que su predecesor.

Aunque AlphaCode 2 muestra resultados impresionantes, el informe reconoce la necesidad de un perfeccionamiento adicional y de una mayor rentabilidad antes de que los sistemas de inteligencia artificial puedan igualar de manera confiable el rendimiento de los mejores programadores humanos.

Papers relevantes

Table GPT

Microsoft Research publicó un artículo que detalla Table GPT, un LLM optimizado para diferentes tareas de tablas, supera a ChatGPT en tareas relacionadas con tablas, como interacciones con hojas de cálculo de Excel.

Atribución en conjunto de datos

Investigadores del MIT, Cohere for AI y otros laboratorios de IA publicaron un artículo que detalla una técnica de procedencia de datos utilizada para atribuciones en el entrenamiento y ajuste de conjuntos de datos.

Ya no perderás tus llaves o cartera en casa

Node Edge Predictor , un modelo que aprendió a predecir dónde se ubicaban los objetos en las casas, los investigadores propusieron una forma para que los robots encuentren objetos en los hogares donde se mueven cosas.

Indicaciones autoadaptativas universales

Google está insistiendo en este Paper, que por cierto es nuestro ideal para los que creamos contenido, “Que la IA conteste (Zero Shot) a la primera y bien”

LLMCompiler: un compilador LLM para llamadas de funciones paralelas

LLMCompiler es un marco que permite llamadas a funciones paralelas con LLM, incluidos modelos de código abierto y de código cerrado, al identificar automáticamente qué tareas se pueden realizar en paralelo y cuáles son interdependientes. ¿Te imaginas la potencia de esto ? [Github][Artículo arXiV]

Chips para IA

Chips Ahoy: Google anuncia nuevos y potentes chips de IA.

AMD también lanza nuevos chips de IA y firma a Meta y Microsoft como clientes, afirma que los chips superan a los de Nvidia en algunos aspectos.

Recursos.

Imagine with Meta AI es la apuesta de META para generar imágenes con IA.

D-ID. : Dispone de una API para crear vídeos con avatares.

Elimina marcas de Agua, con inteligencia artificial, removewatermark.ai. Incluso en modo Bulk.

Implementar RAG con Knowledge Graph y Llama-Index (Artículo y código)

Escalidraw el tablero gratuito de esquemas, y flujos incorpora IA, un ejemplo .- Prompt simple “ Estructura eficiente de una Web”

Imagen

Si tienes imágenes de una sesión fotográfica tradicional en la que la expresión o el posicionamiento del modelo no eran del todo perfectos, ahora puede tomar esa imagen en Leonardo AI y utilizar Image Guidance … forma parte del paquete premium pero supera incluso a MidJourney.

O quizás comenzar a enviar tus tarjetas de Navidad:

Lecturas y Opiniones

Os dejo dos lecturas que me parecen interesantes:

.- Como sabéis Google ha inaugurado su centro de Ciberseguridad en Málaga, Business Insider entrevista al responsable de seguridad de Google Phill Venables y deja algunas afirmaciones interesantes.

.- Sobre el Test de Turing que las IA en tendencia dicen superar … no parece que esto esté tan claro. El mensaje GPT-4 con mejor rendimiento pasó en el 41% de las pruebas, pero no alcanzó el azar ni la línea de base establecida por los participantes humanos (63%).

Hasta la próxima edición de [con]Neurona. Espero que hayas disfrutado de esta entrega; si es así, no dudes en compartir y suscribirte para no perderte futuros contenidos.

Si deseas promocionar tus proyectos o anunciarte, puedes ponerte en contacto con nosotros a través de [iaradar.magazine@gmail.com] o mediante mensaje directo en [twitter.com/Txtetxu1]. ¡Estaremos encantados de colaborar contigo!

![[con]NEURONA](https://substackcdn.com/image/fetch/$s_!tJdB!,w_80,h_80,c_fill,f_auto,q_auto:good,fl_progressive:steep,g_auto/https%3A%2F%2Fsubstack-post-media.s3.amazonaws.com%2Fpublic%2Fimages%2Fed12578b-c54c-4f26-9b05-d7a84fc1538b_768x768.png)

![[con]NEURONA](https://substackcdn.com/image/fetch/$s_!tJdB!,w_36,h_36,c_fill,f_auto,q_auto:good,fl_progressive:steep,g_auto/https%3A%2F%2Fsubstack-post-media.s3.amazonaws.com%2Fpublic%2Fimages%2Fed12578b-c54c-4f26-9b05-d7a84fc1538b_768x768.png)